L’intelligence artificielle est passée du laboratoire à la vie quotidienne avec une rapidité surprenante. Les systèmes qui génèrent du texte, analysent des données ou assistent la prise de décision ne sont plus exceptionnels, mais devenus courants. Pourtant, ces systèmes restent limités. Ils sont conçus pour des tâches spécifiques, aussi impressionnantes soient-elles dans ce cadre restreint.

Au-delà se profile ce que l’on appelle souvent l’intelligence artificielle générale, ou AGI (Artificial General Intelligence), en d’autres termes une IA qui se rapproche du niveau humain.

Le terme suggère un changement de nature plutôt que de degré : non pas seulement des systèmes plus performants, mais des systèmes dotés de capacités générales, capables d’agir, de raisonner et de s’adapter dans une variété de contextes. Que cette transition se produise, et à quelle vitesse, demeure incertain. Ce qui l’est moins, en revanche, c’est la direction : celle de systèmes qui ne seraient plus confinés à des fonctions étroites.

AGI : un concept sans définition fixe (pour l’instant)

L’intelligence artificielle générale est généralement entendue comme un système doté de la capacité à accomplir toute tâche cognitive au moins aussi bien qu’un être humain.

Elle vise à rapprocher les capacités cognitives des machines de celles des humains, non pas en se limitant à l’exécution de tâches isolées, mais en développant une aptitude à apprendre, raisonner et s’adapter à travers une grande diversité de domaines.

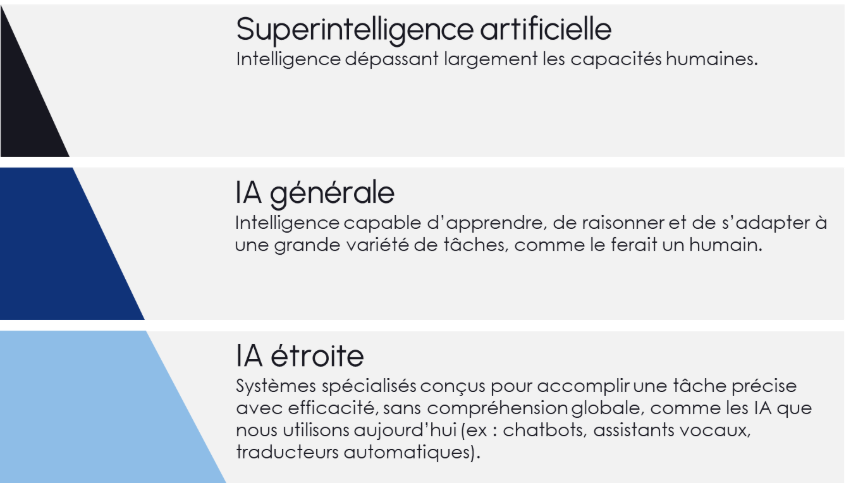

Le schéma ci-dessus présente un descriptif des paliers d’intelligence artificielle.

Cela impliquerait une forme d’intelligence artificielle non liée à une application unique. Au lieu d’être entraînés pour un seul objectif, ces systèmes pourraient transférer des connaissances, réagir à des situations inédites et opérer avec une compréhension plus large du contexte.

Dans le même temps, le concept demeure imprécis. Il n’existe pas de définition consensuelle, et le terme évolue au rythme de la technologie qu’il cherche à décrire. L’AGI est ainsi moins un objectif clairement défini qu’un horizon mouvant, façonné à la fois par le progrès et par les attentes.

Un moment d’opportunité

Dans cette perspective, l’AGI n’est pas seulement une ambition technique, mais un changement dans la manière dont la technologie pourrait être utilisée.

Dans le domaine de la santé, des systèmes plus performants pourraient permettre des diagnostics plus précoces et plus précis, soutenir des décisions thérapeutiques complexes et accélérer le développement de nouveaux traitements. Dans l’industrie, ils pourraient favoriser des processus de production plus adaptatifs, réduire les inefficacités et améliorer la coordination entre systèmes.

Dans les transports, des avancées telles que les véhicules autonomes laissent entrevoir une réduction des erreurs humaines et des formes de mobilité plus réactives. Dans l’ensemble de ces domaines, le potentiel de gains de productivité est évident. Les processus routiniers peuvent être automatisés plus efficacement, laissant davantage de place aux tâches qui requièrent jugement, créativité et interaction humaine.

La promesse ne se limite pas à l’efficacité. Elle réside aussi dans la possibilité de s’attaquer à des problèmes qui ont jusqu’ici résisté aux approches conventionnelles. La question de savoir si cette promesse pourra être concrétisée en pratique reste toutefois ouverte.

Risques et considérations

Les mêmes évolutions qui rendent l’AGI attractive suscitent également des préoccupations. Des analyses récentes, notamment les travaux de McLean et al. (2023), repris dans le MIT AI Risk Repository, décrivent un ensemble de risques étroitement imbriqués.

Au centre se trouve la question du contrôle. Des systèmes dotés d’une autonomie croissante pourraient ne plus rester pleinement soumis à la direction humaine, en particulier une fois déployés à grande échelle. Étroitement liée se pose la question des objectifs. Si ceux-ci sont mal définis, ou évoluent de manière inattendue, les résultats pourraient diverger des intentions initiales.

Ces préoccupations sont amplifiées par les conditions de développement. La pression concurrentielle peut favoriser la rapidité au détriment de la prudence, augmentant le risque de systèmes insuffisamment testés ou compris. Par ailleurs, la question des valeurs reste non résolue. Des systèmes opérant sans cadre éthique fiable peuvent produire des résultats en contradiction avec des normes largement admises.

Les structures de gouvernance existantes pourraient ne pas être adaptées pour faire face à ces défis. Les cadres juridiques et institutionnels, conçus pour des technologies antérieures, s’ajustent difficilement à des systèmes complexes, adaptatifs et difficiles à prévoir.

Au-delà de ces enjeux immédiats subsiste une incertitude plus fondamentale. Des systèmes hautement avancés pourraient avoir des conséquences dépassant les applications individuelles. La possibilité de risques plus larges, voire existentiels, ne peut être exclue, même si leur probabilité reste débattue.

Pourquoi la gouvernance et l’IA responsable sont essentielles

Pour cette raison, la gouvernance n’est pas un élément secondaire, mais une condition préalable.

À mesure que les systèmes d’IA deviennent plus performants, la question centrale se déplace de ce qu’ils peuvent faire vers la manière de les maintenir sous contrôle humain. L’IA responsable, en ce sens, n’est pas seulement une question de principe, mais une nécessité pratique. Elle implique de la transparence dans le fonctionnement des systèmes, une responsabilité claire quant à leurs résultats, et la capacité d’intervenir lorsque cela est nécessaire.

Cela va au-delà des garanties techniques. Une gouvernance efficace suppose l’établissement de normes de développement, des tests rigoureux avant déploiement et des limites claires quant aux usages acceptables. Elle nécessite également des mécanismes de suivi une fois les systèmes en fonctionnement, en particulier à mesure qu’ils évoluent ou s’adaptent.

Les cadres juridiques et institutionnels jouent un rôle crucial, mais présentent des limites. Les réglementations actuelles n’ont pas été conçues pour des systèmes capables d’apprendre, de s’adapter et d’opérer avec un haut degré d’autonomie. Leur mise à jour, tout en préservant la flexibilité nécessaire à l’innovation, constitue un défi majeur.

Se pose également une question plus large de contrôle et de répartition. Qui développe ces systèmes, qui y a accès et qui est responsable en cas de défaillance ne sont pas seulement des questions techniques, mais aussi politiques et sociétales. En l’absence de réponses claires, l’équilibre entre innovation et supervision risque de devenir instable.

La gouvernance doit donc s’exercer à plusieurs niveaux : technique, juridique et sociétal. Elle doit instaurer des garde-fous sans freiner le progrès, et donner une direction sans rigidité. La capacité à atteindre cet équilibre jouera un rôle déterminant dans l’évolution de l’AGI.

Une trajectoire encore ouverte

L’AGI est peu susceptible d’apparaître sous la forme d’une percée unique. Il est plus probable qu’elle émerge progressivement, par des avancées incrémentales et des combinaisons inattendues.

Ce qui est déjà perceptible, c’est un mouvement constant vers des systèmes plus flexibles, plus performants et plus profondément intégrés aux activités humaines. Reste à savoir si ce processus conduira effectivement à ce que l’on qualifie aujourd’hui d’« intelligence générale ».

Ce qui est certain, en revanche, c’est que le développement de l’intelligence artificielle entre dans une nouvelle phase : une phase où la distinction entre outil et capacité devient moins nette, et où la question n’est plus seulement ce que la technologie peut faire, mais quel rôle elle doit jouer.

Au-delà de l’AGI ?

À l’extrémité de cette trajectoire se trouve une idée plus spéculative, souvent désignée comme l’intelligence artificielle superintelligente. (cf. palier 3 du schéma)

Elle renverrait à des systèmes dépassant les capacités cognitives humaines et capables de résoudre des problèmes aujourd’hui hors de portée. Ces visions sont familières et souvent associées à des scénarios dans lesquels les machines opèrent à un niveau qui n’est plus comparable au raisonnement humain.

Pour l’instant, il s’agit d’une construction théorique. La question de savoir si de tels systèmes émergeront, et sous quelle forme, reste incertaine. Elle dépasse les développements actuels et demeure ouverte.

Préparer votre organisation à la prochaine génération d’IA

Dans ce contexte de transformation accélérée, les organisations ne peuvent plus considérer l’intelligence artificielle comme un simple sujet d’innovation technologique. Son intégration soulève désormais des enjeux stratégiques, opérationnels et de gouvernance qui nécessitent une approche structurée et responsable.

La plateforme Naaia, nous accompagnons les entreprises et institutions dans le pilotage de la gouvernance IA, l’identification des exigences applicables, la cartographie des systèmes d’IA, la classification des risques et la mise en œuvre d’une gouvernance opérationnelle de l’IA responsable.