L’intelligence artificielle (IA) révolutionne les secteurs d’activité, de la santé à la finance, mais son adoption massive soulève d’importants défis éthiques et sécuritaires. Face à cette montée en puissance, les gouvernements du monde entier accélèrent leurs efforts pour réguler l’IA.

L’objectif ? Trouver un équilibre entre l’innovation et la réduction des risques.

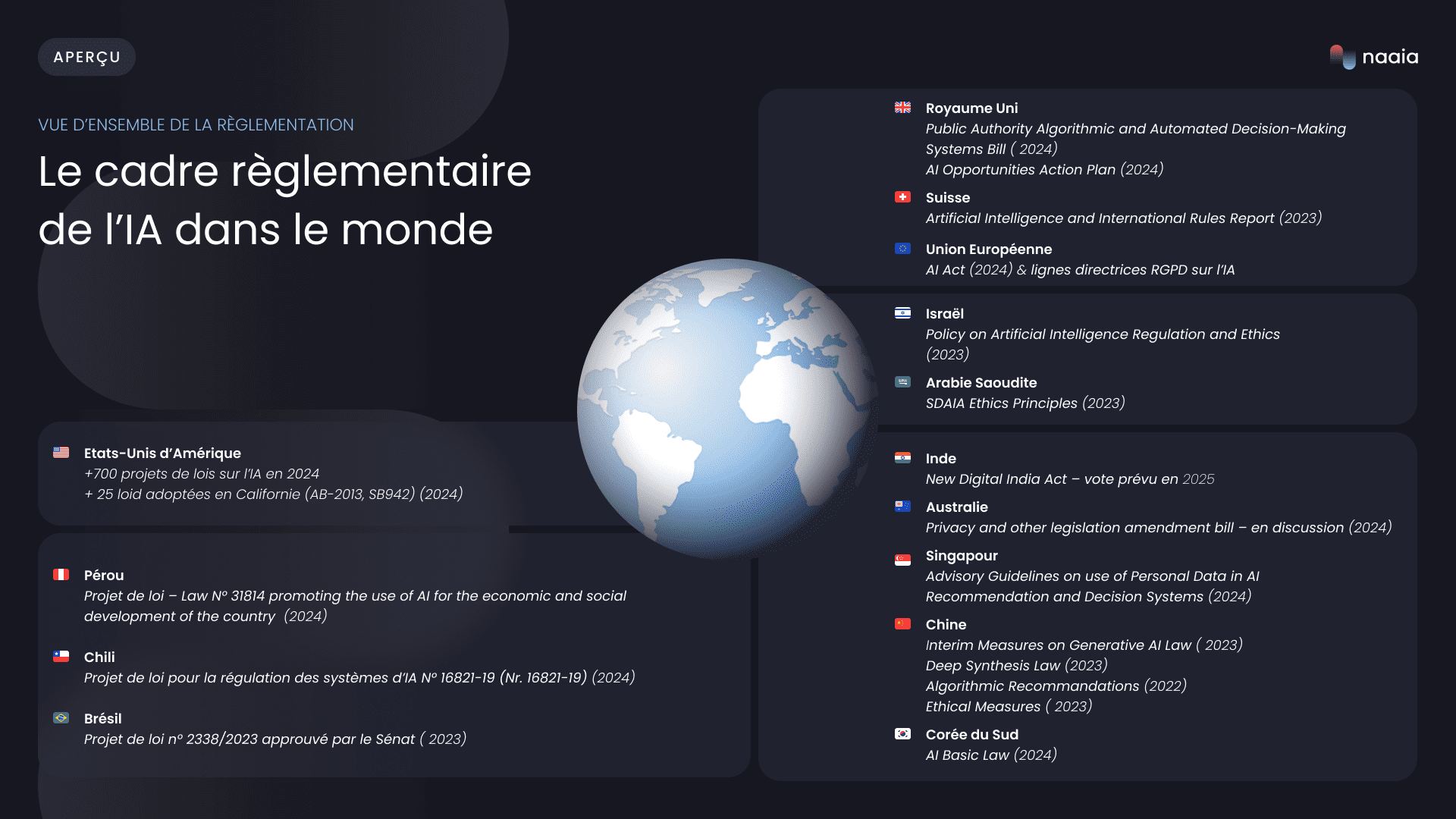

Cependant, le paysage réglementaire actuel demeure fragmenté, souvent décrit comme un « patchwork » complexe, ce qui complique la mise en place d’une gouvernance harmonisée. Dans cet article, nous explorons les approches réglementaires dans différentes régions du monde, les statistiques clés de la gouvernance et les perspectives pour un cadre global.

Où en est la réglementation de l’intelligence artificielle dans le monde ?

En Europe, un cadre pionnier pour réglementer l’IA

L’Union européenne adopte une approche graduelle basée sur les niveaux de risque des systèmes d’intelligence artificielle dans le cadre de l’AI Act. Ce cadre impose des obligations proportionnées à la dangerosité potentielle de chaque application.

Par exemple, un outil d’IA destiné à la correction d’erreurs grammaticales est classé comme un système à faible risque et n’est soumis qu’à des exigences légères. En revanche, un système d’évaluation des risques de crédit est considéré comme à haut risque. Pour ce type de système, des obligations strictes s’appliquent, incluant :

- La création d’une documentation technique complète,

- La mise en place d’un contrôle humain continu,

- L’élaboration d’un système de gestion des risques performant.

Cette réglementation couvre également les modèles d’IA à fort impact, capables d’exécuter une large gamme de tâches, comme les modèles de type LLAMA ou la série GPT. L’objectif est de concilier innovation et protection des droits fondamentaux, tout en garantissant un usage responsable des technologies d’IA.

États-Unis : Un patchwork législatif en constante évolution

Aux États-Unis, nous observons une absence de cadre AI fédéral unique. Cela a donné naissance à un véritable patchwork de lois au niveau des états fédérés.

« En 2024, les législateurs des États-Unis ont présenté plus de 700 projets de loi liés à l’IA, et 2025 a démarré encore plus rapidement, avec plus de 40 propositions sur les registres dans les premiers jours de la nouvelle année. »

Certains états se démarquent :

- Californie : plus de 25 lois adoptées,

- Colorado et New York : chacun avec 5 lois en vigueur,

- Texas : 4 lois déjà appliquées.

- Washington : 6 lois adoptées.

Autres Etats fédérés avec une activité réglementaire sur l’IA : Illinois, Louisiana, Connecticut, Tennessee, Utah, Rhode Island, New Jersey, Michigan, Massachusetts etc.

Cependant, cette absence de cohérence fédérale pose des problèmes pour les entreprises cherchant à se conformer à des réglementations multiples. En parallèle, certaines initiatives, comme l’Executive Order on Safe, Secure and Trustworthy Artifical Intelligence, ont été suspendues en 2025, illustrant l’instabilité des approches législatives.

APAC : Une diversité d’approches selon les priorités nationales

En Asie, des pays comme la Chine et la Corée du Sud adoptent des stratégies solides et spécifiques.

La Chine, fidèle à ses valeurs socialistes, adopte une vision qui privilégie un contrôle étatique centralisé pour encadrer le développement et le déploiement des systèmes d’intelligence artificielle avec des règles strictes en matière de transparence et de sécurité. Par exemple, les fournisseurs de services d’IA doivent étiqueter le contenu généré par l’intelligence artificielle et permettre aux utilisateurs de refuser les recommandations algorithmiques.

4 textes de loi sur l’IA sont actuellement en vigueur : Interim Measures on Gen AI entrée en vigueur en août 2023, Deep Synthesis, Algorithmic Recommandations et Ethical Measures et plusieurs projets de loi sont en cours.

En Corée du Sud, une loi contraignante sur l’IA votée fin décembre 2024, la Basic AI Law, entrera en vigueur en janvier 2026, marquant une étape majeure dans la région APAC.

Singapour de son côté se distingue par des cadres avancés de gestion des risques, notamment :

- Review of Observations on the Risk Management of AI Models for Financial Institutions (MAS, 2024), une évaluation approfondie pour les institutions financières.

- Advisory Guidelines on the Use of Personal Data in AI Recommendation and Decision Systems (2024), qui traite des enjeux liés aux données personnelles.

En Australie, l’Australian National AI Capability Plan (2024) met l’accent sur le développement des compétences et des infrastructures pour renforcer la compétitivité du pays dans le domaine de l’IA.

Le Japon propose des orientations pratiques comme :

- Guide on Evaluation Perspectives on AI Safety (2024), qui examine les critères de sécurité des systèmes d’IA.

- Guidance on AI and Copyright Law (2024), qui traite des implications de l’IA sur les droits d’auteur.

Dans d’autres régions : Des initiatives qui émergent progressivement

Projets de loi en Amérique du Sud – Brésil, Pérou et Chili :

Brésil

Le projet de loi n° 2338/23 établit un cadre national pour le développement, l’utilisation et la gouvernance des systèmes d’IA. Déjà adopté par le Sénat, il attend encore l’examen de la Chambre des représentants et l’approbation présidentielle pour entrer en vigueur.

Pérou

La « Réglementation de la Loi n° 31814 » vise à promouvoir l’utilisation de l’intelligence artificielle dans le but de favoriser le développement économique et social du pays.

Chili

Le projet de loi n° 16821-19, actuellement en discussion à la Chambre des députés, cherche à réguler l’utilisation des systèmes d’intelligence artificielle au Chili.

Projet de loi national au Royaume Uni

Le cadre de la UK AI regulation repose sur deux initiatives majeures :

- Public Authority Algorithmic and Automated Decision-Making Systems Bill (2024), qui vise à encadrer l’utilisation d’algorithmes par les institutions publiques.

- AI Opportunities Action Plan (2024), qui définit des priorités pour maximiser les opportunités offertes par l’IA tout en en maîtrisant les risques.

Les réglementations sur l’IA en Arabie Saoudite

L’Arabie Saoudite a publié plusieurs directives, dont :

- SDAIA Ethics Principles (2023), un ensemble de principes éthiques avec une approche par les risques.

- Guidelines for Generative AI (2024), qui encadrent les usages spécifiques de l’IA générative.

Organisations internationales et régionales

Les efforts en matière de réglementation de l’IA ne se limitent pas aux États. Plusieurs organisations internationales et régionales jouent un rôle clé dans l’élaboration de cadres collaboratifs :

- Conseil de l’Europe : Développement de standards pour les droits humains et la gouvernance de l’IA.

- OMC et OIT : Analyse des impacts économiques et sociaux des technologies d’IA.

- ONU / UNESCO : Promotion d’une approche éthique et inclusive.

- ASEAN : Initiatives pour renforcer la coopération régionale en matière d’IA.

- BRICS : Mise en place de mécanismes de collaboration technologique.

- G7 / G20 : Coordination des politiques entre grandes puissances mondiales.

- OCDE : Élaboration de principes directeurs pour une IA responsable.

Les chiffres-clés qui dessinent le paysage de la gouvernance de l’IA

Les statistiques sur la gouvernance de l’IA montrent à quel point ce sujet est une priorité mondiale. Selon l’OCDE, on recense actuellement plus de 2083 initiatives dans le monde :

- 426 politiques adoptées,

- 401 politiques en cours de discussion,

- 28 politiques révoquées ou rejetées.

Les réponses réglementaires se déclinent en :

- 259 lois,

- 216 schémas directeurs,

- 130 ordonnances,

- 71 enquêtes.

Ces chiffres montrent que, bien que de nombreux efforts soient en cours, il reste encore beaucoup à faire pour harmoniser les cadres existants.

Préparons-nous pour un avenir harmonisé de l’intelligence artificielle.

Pour nous, la réglementation de l’IA est une opportunité de garantir un développement technologique éthique et durable. Des cadres comme l’AI Act en Europe posent des bases solides, mais la collaboration internationale sera indispensable pour surmonter les défis liés à la fragmentation actuelle.

Nous invitons les entreprises à adopter une approche proactive :

- Intégrez dès maintenant des standards de sécurité.

- Surveillez les tendances législatives.

- Collaborez avec les régulateurs pour anticiper les évolutions.

Avec des efforts conjoints, nous pouvons garantir que l’IA continuera à transformer nos sociétés de manière positive tout en respectant les valeurs fondamentales.

Naaia agit comme un “one stop shop” pour les organisations. Tous les besoins de mise en conformité et gestion des risques sont couverts avec des efforts limités.

Vous souhaitez découvrir la plateforme Naaia ? N’hésitez pas à demander une démo !